如何获取网站所有页面链接

在日常生活中,我们有时会需要获取一个网站的所有链接地址,无论是因为工作需要,还是出于个人兴趣。但你可能并不知道,这其实是一项技术活,有多种方法和工具可以帮助我们实现这一目的。接下来,我们就来详细介绍几种获取网站整站链接地址的实用方法。

方法一:使用网站地图工具

对于大多数网站来说,它们都会有一个网站地图(Sitemap),这是一个XML文件,列出了网站上的所有页面URL。通过这个网站地图,我们可以快速获取网站的整站链接。

1. 选择工具:你可以使用一些在线工具来自动生成和提取网站地图。例如,爱站网云就提供了一个免费的工具包,你可以登录后选择“网站地图/Sitemap”工具。

2. 添加网站并抓取:在工具中,添加你想要获取链接的网站,然后点击“抓爬”。这个工具会自动提取网站的所有链接。

3. 生成XML文件:抓取完成后,你可以选择生成XML文件,这个文件包含了网站的所有链接。

4. 提交到搜索引擎:得到XML文件后,你可以将其提交到百度站长平台等搜索引擎平台,以便搜索引擎更快地索引你的网站。

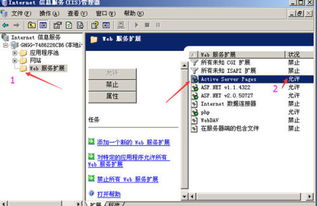

方法二:利用DedeCMS系统后台

如果你使用的是DedeCMS(织梦内容管理系统),你可以通过系统后台获取网站的链接。

1. 登录后台:打开DedeCMS系统后台,输入管理员账号和密码进行登录。

2. 进入模板设置:在后台管理界面,点击“模板”,然后选择“全局标记测试”。

3. 输入测试代码:在“输入要测试的局部代码”中,输入以下代码:`{dede:arclist row="100000"}

[field:fulltitle/]http://www.网站域名.com[field:arcurl/]

{/dede:arclist}`。这里的“row”参数可以设置为你想抓取的文章数量,理论上可以设置为一个很大的数字来抓取整个网站的文章。

4. 提交测试并获取结果:点击“提交测试”,在结果中你会看到所有文章的标题和链接。

需要注意的是,这个方法主要获取的是文章页的链接,不包括列表页和栏目页。

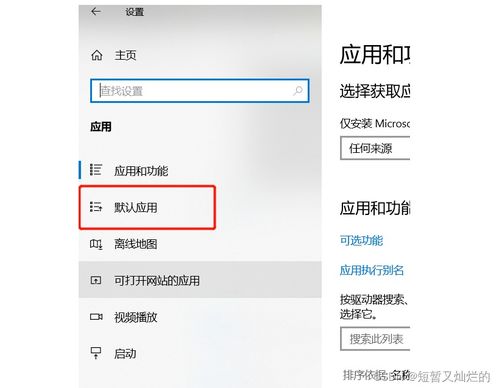

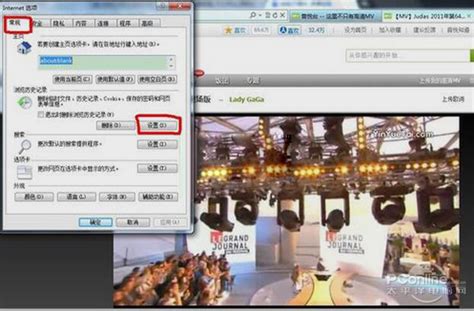

方法三:使用浏览器和搜索引擎

如果你不想使用工具或后台,还可以通过浏览器和搜索引擎来获取网站的链接。

1. 直接在浏览器地址栏输入:如果你知道网站的一部分内容或名称,可以尝试在浏览器的地址栏中输入关键词,浏览器通常会根据你的输入提供相关的网址建议。

2. 使用搜索引擎的网址搜索功能:在搜索引擎中输入你想要找的网页的关键词,然后在搜索结果页面中选择“网址”或“网站”筛选条件,这样搜索引擎就会只显示与你的关键词相关的网址。

3. 查看网页上的链接:如果你已经在浏览某个网页,并且想要找到该网页上的另一个链接,你可以直接点击这个链接。你也可以右键点击网页,选择“查看页面源代码”,在源代码中找到所有的链接。

方法四:使用PHP编程语言和网络爬虫

对于有一定编程基础的人来说,可以使用PHP编写一个网络爬虫来获取整个网站的所有链接。

1. 使用PHP内置函数:你可以使用`get_file_contents()`函数获取指定URL页面的内容,然后使用正则表达式匹配出所有的链接。不过,这种方法比较原始,对复杂网页的处理能力有限。

2. 使用第三方库:有许多第三方库提供了更加方便和高效的方法来获取网站的链接,比如Guzzle和SimpleHTMLDom。这些库可以帮助你解析HTML文档,提取出所有的链接。

3. 编写爬虫脚本:你可以使用PHP的cURL函数库发起HTTP/HTTPS请求,获取网站的HTML内容,然后使用DOMDocument类对HTML进行解析,找到所有的`a`标签元素,提取出它们的`href`属性值作为链接。

需要注意的是,使用爬虫技术时需要遵守相关法律法规和网站政策,不要对服务器造成过大的负担,也不要进行恶意请求。

方法五:使用在线链接爬取工具和网站爬虫工具

除了手动编写爬虫脚本,你还可以使用一些在线链接爬取工具和网站爬虫工具。

1. 在线链接爬取工具:有一些在线工具可以帮助你快速爬取网站的链接,比如Screaming Frog、Xenu Link Sleuth、Ahrefs Backlink Checker等。这些工具通常需要你输入网站的URL,然后它们会自动爬取网站的所有链接,并生成一个报告。

2. 网站爬虫工具:你还可以使用一些开源的爬虫工具,比如Scrapy、BeautifulSoup、Selenium等。这些工具提供了强大的爬虫功能,可以帮助你快速获取网站的所有链接。你需要根据自己的需求和编程语言选择合适的工具。

注意事项

在获取网站整站链接地址时,有几点需要注意:

1. 遵守法律法规和网站政策:在爬取网站链接时,一定要遵守相关的法律法规和网站政策,不要进行恶意请求或侵犯他人隐私。

2. 尊重网站隐私和版权:在获取和使用网站链接时,要尊重网站的隐私和版权,不要进行未经授权的复制和传播。

3. 处理特殊情况:有些网站可能会使用JavaScript动态加载链接,或者基于AJAX的动态网页。对于这些特殊情况,可能需要使用更复杂的技术来处理,比如使用PhantomJS或Puppeteer这样的headless浏览器库来模拟浏览器行为。

4. 避免对服务器造成过大负担:在爬取网站链接时,要注意控制请求的频率和数量,避免对服务器造成过大的负担。可以添加适当的延时或使用代理等方式进行访问。

总之,获取网站整站链接地址的方法有很多种,你可以根据自己的需求和情况选择合适的方法。无论使用哪种方法,都要注意遵守相关法律法规和网站政策,尊重网站的隐私和版权。

- 上一篇: 快预约小程序预约流程指南

- 下一篇: 中国电信宽带进度查询指南

-

提取网页所有链接的方法资讯攻略12-05

提取网页所有链接的方法资讯攻略12-05 -

如何在铁路12306找到客服电话?资讯攻略02-11

如何在铁路12306找到客服电话?资讯攻略02-11 -

揭秘友情链接:构建网络桥梁的神奇力量资讯攻略01-19

揭秘友情链接:构建网络桥梁的神奇力量资讯攻略01-19 -

高效下载网站视频的方法资讯攻略11-06

高效下载网站视频的方法资讯攻略11-06 -

揭秘:在ASP中如何优雅地为超链接添加ID资讯攻略03-28

揭秘:在ASP中如何优雅地为超链接添加ID资讯攻略03-28 -

如何找到Steam交易链接?资讯攻略11-16

如何找到Steam交易链接?资讯攻略11-16